Varianciaelemzés

Varianciaelemzés| Természet | Statisztikai módszer ( d ) |

|---|---|

| Betűszó | (in) ANOVA |

| Írta le | Szovjet Örmény Enciklopédia |

A statisztikák , az elemzést variancia (kifejezés gyakran rövidítve a angol kifejezés ANOVA : egy ELEMZÉSE o f va riance ) egy sor statisztikai modellek segítségével ellenőrizhető, hogy az eszköz a csoportok érkeznek ugyanabból a populációból. A csoportok megfelelnek a kvalitatív változó módszereinek (pl. Változó: kezelés; módok: sportedzési program , étrend-kiegészítők ; placebo ), és az átlagokat egy folyamatos változóból (pl. Izomgyarapodás) számolják.

Ezt a tesztet akkor alkalmazzuk, amikor egy vagy több kategorikus magyarázó változót mérünk (akkor variációs tényezőknek nevezzük, amelyek különböző módozatait néha „szinteknek” nevezik), amelyek befolyásolják a magyarázandó folyamatos változó törvényét. Egyfaktoros elemzésről akkor beszélünk, amikor az elemzés egyetlen variabilitási faktor, kétfaktoros elemzés vagy egyébként többtényezős elemzés által leírt modellhez kapcsolódik.

Történelem

Ronald Aylmer Fisher először mutatja be a variancia kifejezést, és formális elemzését javasolja egy 1918-as cikkben: A rokonok közötti összefüggés a mendeli öröklés feltételezésével . A varianciaanalízis első alkalmazását 1921-ben tették közzé. A variancia-elemzés széles körben ismertté vált, miután bekerült Fisher 1925-ben megjelent Statisztikai módszerek kutatómunkákhoz című könyvébe .

Elv

A varianciaanalízis lehetővé teszi a kvantitatív változó viselkedésének tanulmányozását egy vagy több kvalitatív változó függvényében, más néven kategorikus névlegesnek. Amikor egyszerre több kvalitatív változó magyarázó erejét akarjuk tanulmányozni, akkor többszörös varianciaanalízist ( MANOVA ) fogunk használni . Ha egy modell kategorikus és folyamatos magyarázó változót tartalmaz, és tanulmányozni kívánja azokat a törvényeket, amelyek a folyamatos magyarázó változókat összekapcsolják a magyarázandó kvantitatív változóval a kategorikus változók egyes kategóriái szerint, akkor a kovariancia elemzését ( ANCOVA ) kell használni.

Modell

A varianciaanalízis első lépése az elméleti modell megírása a vizsgálandó probléma szerint. Gyakran lehet több modellt írni ugyanarra a problémára, azoknak az elemeknek megfelelően, amelyeket be akar integrálni a tanulmányba.

Az általános modell a következő:

a megmagyarázandó kvantitatív változóval állandó, összefüggés a magyarázó változók és a mérési hiba között. Felveti azt az alapvető feltételezést, hogy a hiba normális eloszlást követ .

Magyarázó változók

A kategorikus változóknak két típusa van: véletlenszerű hatással vagy anélkül.

Rögzített hatású változó esetén minden modalitáshoz tartozik egy megfelelő rögzített érték. Az elméleti modell nagybetűvel van megírva:

a i = 0, az i = 1, stb

Ne feledje, hogy a kvantitatív változó mindig megegyezik az µ-vel növelt értékkel (bár pozitív vagy negatív értékeket is felfoghat).

Abban az esetben, egy olyan változó, egy véletlen hatás , a változó eredményeket egy feltételezett normális eloszlás, amelyet hozzáadunk a rögzített értéket. Az elméleti modellben kis görög betűvel íródtak:

a és

A csak rögzített és véletlen hatású magyarázó változókon alapuló modellt kevert modellnek nevezzük.

Alapvető feltételezések

A varianciaanalízis általános formája a Fisher-teszten , tehát az eloszlások normalitásán és a minták függetlenségén alapul.

- Az eloszlás normalitása: a nullhipotézis szerint feltételezzük, hogy a minták ugyanabból a populációból származnak és normális eloszlást követnek. Ezért ellenőrizni kell az eloszlások normalitását és a homoszkedaszticitást (a varianciák homogenitása, például Bartlett- vagy Levene- tesztekkel ). Ellenkező esetben használhatjuk a varianciaanalízis nemparaméteres változatait ( ANOVA Kruskal-Wallis vagy ANOVA Friedman ).

- A minták függetlensége: feltételezzük, hogy minden elemzett minta független a többi mintától. A gyakorlatban ez az a probléma, amely lehetővé teszi számunkra, hogy feltételezzük, hogy a minták függetlenek. A függő minták gyakori példája a replikátumokkal végzett mérések (mindegyik mintát többször elemzik). Függő minták esetében nemparaméteres esetekben ismételt mértékű varianciaanalízist vagy Friedman-féle ANOVA-t kell használni .

Vizsgálandó hipotézisek

A nullhipotézis megfelel annak az esetnek, amikor az eloszlások ugyanazt a normális eloszlást követik.

Az alternatív hipotézis az, hogy van legalább egy eloszlás, amelynek átlaga eltér a többi eszköztől:

.Varianciabontás

A varianciaanalízis első lépése az összes minta teljes varianciájának magyarázata abban áll, hogy a tényezők miatti variancia függvényében (a modell által magyarázott variancia), a tényezők közötti kölcsönhatás miatti variancia és a véletlenszerű maradék variancia (a variancia, amelyet a modell nem magyaráz meg). becslő torzító variancia lévén , a számításokhoz a négyzetes hibák összegét ( SCE French, SS a Sum Square English esetében) és a becslő elfogulatlan varianciáját (más néven átlagos négyzet vagy CM ) használják.

A mérés eltérése (implicit eltérés az átlagtól) a különbség e mérés és az átlag között:

.Az SCE eltérések négyzeteinek összegét és a becslőt a következő képletek alapján számítják ki:

Ezután felírható az összes eltérés négyzetének összege, amely lineáris összetételű az egyes magyarázó változók eltéréseinek négyzeteinek és az egyes interakciókhoz tartozó eltérések négyzetének összegének lineáris összetétele :

Ez a varianciabontás mindig érvényes, még akkor is, ha a változók nem követik a normális eloszlást.

Fisher-teszt

Feltételezés szerint a megfigyelt változó normális eloszlást követ . A χ 2 törvénye, ahol k szabadságfokot k normális négyzetváltozó összegeként határozunk meg , az eltérések négyzetösszegei a laws 2 törvényeit követik , a szabadság fokainak számával :

A Fisher- t a két laws 2 törvény arányaként határozzuk meg . A nullhipotézis esetében két, a varianciát elfogulatlan becslő közötti kapcsolatnak Fisher törvényét kell követnie :

Ha az F értéke nem kompatibilis ezzel a Fisher-törvénnyel (vagyis a értéke nagyobb, mint az elutasítási küszöb), akkor elutasítjuk a nullhipotézist: arra a következtetésre jutunk, hogy statisztikailag szignifikáns különbség van az eloszlások között. A variabilitási tényező nem különíti el a vizsgált populációt azonos csoportokra. Emlékeztetőül: az elutasítási küszöbértéket a referenciatáblázatokban előre kiszámítják, az első fajta kockázat és a szabadság és a két fok függvényében .

"Post-hoc" tesztek

A varianciaanalízis egyszerűen lehetővé teszi a kérdés megválaszolását, hogy az összes minta ugyanazt a normális eloszlást követi-e. Ha elvetjük a nullhipotézist, ez az elemzés nem teszi lehetővé, hogy megtudjuk, mely minták térnek el ettől a törvénytől.

A megfelelő minták azonosítása különböző "post-hoc" tesztek (vagy több összehasonlítás (in) , MCP for Multiple Comparison Test ) segítségével. Ezek a tesztek általában megkövetelik az elemzés kockázatainak növelését (a statisztikai kockázat szempontjából). Ez egy általánosítás a Student t tesztjének két populációjának összehasonlítására a hiba kiigazításával (FDR, FWER stb.). Például: Ficher LSD-tesztjei, Newman-tesztjei -Keuls, Tukey HSD-tesztjei, Bonferroni és Sheffé tesztek.

Különösen a modern biológiában az MCP-tesztek lehetővé teszik a kockázat megfelelő figyelembevételét a nagyszámú elvégzett vizsgálat ellenére (például a biochipek elemzéséhez).

Ha több magyarázó változót elemzünk, mindegyik többféle modalitással, a lehetséges kombinációk száma gyorsan nagyon nagy lesz.

Egyirányú varianciaanalízis

Az egyirányú ANOVA néven is emlegetett egyirányú varianciaanalízis akkor alkalmazható, ha egyetlen variabilitási tényezőt kíván figyelembe venni.

Jelölések Nézzük I minta mérete eredő I populációk, amelyek követik azt normális törvények azonos szórás. Minden egyén meg van írva , és . A teljes munkaerő .

A mintánkénti és az összes átlagot felírják:

Varianciabontás

A modell leírása:

Ilyen feltételek mellett megmutatjuk, hogy az eltérések négyzeteinek összege (és ezért a variancia ) egyszerűen kiszámítható a következő képlettel:

A teljes variancia modellel magyarázható része ( más néven osztályok közötti variabilitás , SSB vagy az osztályok közötti négyzet összege ), és a teljes variancia azon része, amelyet a modell nem magyarázhat ( véletlenszerű variabilitásnak is nevezzük , osztályon belüli variabilitás , zaj , SSW vagy az osztályon belüli négyzet összege ) a következő képletekkel adhatók meg:

Demonstráció . Lebontva , tudunk írni . Észrevette, hogy , tudunk írni .Maradékelemzés

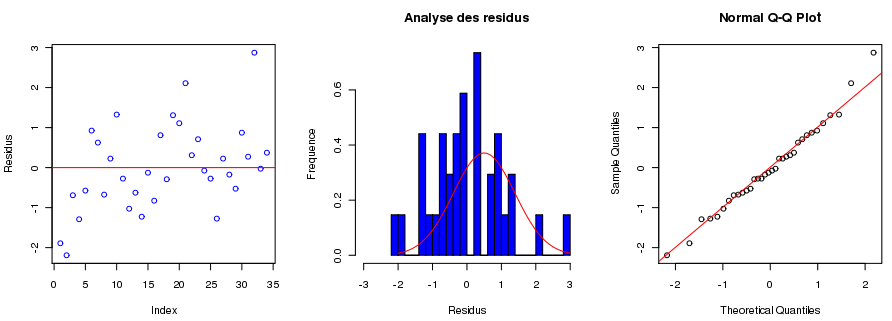

Mindig lehetséges, hogy a modell nem megfelelő, és van egy ismeretlen (vagy feltételezhetően eleve haszontalan) variabilitási tényező, amely nincs integrálva a modellbe. Elemezni lehet a maradványok eloszlásának normalitását az ilyen típusú elfogultság keresése érdekében. A modell maradványainak normális eloszlást kell követniük ( ). A szokásos törvénytől való bármilyen jelentős eltérés grafikusan tesztelhető vagy vizualizálható:

Fisher-teszt

A szabadság fokai és eltérései Feltételezés szerint a megfigyelt változó normális eloszlást követ . A du² törvény a szabadsági fokkal úgy definiáljuk, hogy az összeg a négyzetes normális változók , az összegek négyzetek az eltérések kövesse az alábbi χ 2 törvényeket , és a szintek számát a tényező változékonyság és a teljes egyedszám:A szórásokat úgy kapjuk meg, hogy az eltérések négyzetének összegét vesszük figyelembe a szabadság fokainak számában :

A Fisher törvény úgy definiáljuk, mint az arány a két törvények χ 2 , a jelentés tehát az következik, egy Fisher Act :

Megjegyzés: A szabadsági fokok bomlása megfelel az nm méretű vektortér további és ortogonális altereknek a megfelelő dimenziókkal és

Fisher törvényének megfelelőségi teszt :

Kiderül (amint az a matematikai bontásban is látható), hogy a két kifejezés egyaránt becsli a maradék változékonyságot, ha az A faktornak nincs hatása. Sőt, ez a két kifejezés egyenként χ 2 törvényt követ , arányuk tehát egy F törvényét követi (e törvények szabadságának mértékét lásd még). Összegezzük:

- Ha az A faktornak nincs hatása, akkor az F törvénynek az aránya és követi azt, és ellenőrizhető, hogy az arány értéke "meglepő" egy F törvény esetén

- Ha az A faktornak van hatása, akkor a kifejezés már nem a maradék változékonyság becslése, és az arány már nem követi az F törvényét. Összehasonlíthatjuk az arány értékét az F törvény várható értékével, és láthatjuk, megint mennyire „elképesztő” az eredmény.

A dolgok ilyen módon történő összegzése segít tisztázni az elképzelést, de megfordítja a megközelítést: a gyakorlatban az α kockázat megadásával megkapjuk az arány arányát , amelyet összehasonlítunk egy F törvényével (lásd a tesztekről és azok kockázatairól szóló cikket ) . Ha a kapott érték túl nagy, arra a következtetésre jutunk, hogy az arány valószínűleg nem követi az F törvényét, és az A faktornak van hatása. Ezért arra a következtetésre jutunk, hogy van különbség az eszközökben.

az előző bekezdésben bemutatott becslő (első technikai megközelítés) és a becslő . Kivezetjük Fisher F-jét, amelynek eloszlása ismert és táblázatos a következő feltételezések szerint:

- A maradványokat normálisan osztják el

- Nulla reménnyel

- Az i kategóriától független varianciával

- A zéró kettő az két kovariancia (függetlenség)

Ezeknek a feltételezéseknek való megfelelés biztosítja a varianciaanalízis érvényességét . Ők ellenőrzik a posteriori különböző módszerekkel (normalitás tesztek szemrevételezésével, a hisztogram a maradékok, vizsgálata a grafikont a maradékok függvényében a becslések) lásd a használati feltételek alább.

ANOVA asztal

Az ANOVA táblázat összefoglalja a szükséges számításokat:

| A variancia forrása | Az eltérések négyzetének összege |

A szabadság fokai | Variancia | F | p-érték |

|---|---|---|---|---|---|

| Osztályközi | |||||

| Osztályon belül | |||||

| Teljes |

Szemléltető példa

Vegyünk egy példát a módszer szemléltetésére. Képzeljünk el egy tenyésztőt, aki új tehenet szeretne vásárolni a tejtermeléséhez. Három különböző tehénfajtája van, ezért felmerül a kérdés, hogy a fajta fontos-e az általa választott. Információként rendelkezik minden egyes állat fajtájával (ez a diszkrét magyarázó változó vagy variabilitási tényező , amely 3 különböző értéket vehet fel) és napi tejtermelésükről (ez az a folyamatos magyarázandó változó, amely megfelel a tej literben).

Példánkban a nullhipotézis abból indul ki, hogy minden tehén fajtától függetlenül ugyanazt a napi tejet termeli (a véletlenszerű tényező kivételével). Az alternatív hipotézis abból indul ki, hogy az egyik fajta lényegesen több vagy kevesebb tejet termel, mint a többi.

Tegyük fel, hogy a produkciók:

- A versenyre: 20,1; 19,8; 21,3 és 20,7

- B versenyre: 22,6; 24,1; 23,8; 22,5; 23,4; 24,5 és 22,9

- C versenyre: 31,2; 31,6; 31,0; 32,1 és 31,4

| Verseny | Vágott | Átlagos | Variancia |

|---|---|---|---|

| NÁL NÉL | 4 | 20,475 | 0,443 |

| B | 7 | 23.4 | 0,59333 |

| VS | 5. | 31.46 | 0,178 |

| Teljes | 16. | 25,1875 | 20.90117 |

ANOVA táblázat :

| A variancia forrása | Az eltérések négyzetének összege |

A szabadság fokai | Variancia | F | p-érték |

|---|---|---|---|---|---|

| Osztályközi | 307.918 | 2 | 153,959 | 357,44 | 4.338 e-12 |

| Osztályon belül | 5.6 | 13. | 0,431 | ||

| Teljes | 313,518 | 15 |

Kétirányú varianciaanalízis

Kétirányú ANOVA-nak is nevezik , a kétirányú varianciaanalízis akkor alkalmazható, ha két változékonysági tényezőt kívánunk figyelembe venni .

Varianciabontás

Vagyis az első variabilitási tényező, amely felveheti a szinteket , a második variabilitási tényező, amely felveheti a szinteket , az egyedek száma az első faktor szintjén és a második faktor szintje , az egyedek teljes száma és az egyes alcsoportok egyedszámát (egy adott i és j szint esetében). A magyarázandó változót a , és a segítségével írjuk .

A magyarázható változó a relációval modellezhető:

azzal a hatás szintjének az első tényező, a hatás a szint a második tényező, a kölcsönhatás hatása a két tényező között, és a véletlen hiba (amely aztán normális eloszlást követ ).

Az egyfaktoros esetben bemutatott számítás átültethető a kétfaktoros esetre:

Az első tényezővel magyarázható teljes variancia aránya ( ), a második tényezővel magyarázott teljes variancia aránya ( ), a két tényező közötti kölcsönhatás ( ) és a teljes variancia aránya, amelyet a modell nem magyarázhat ( véletlenszerű variabilitásnak vagy zajnak is nevezik ) a képletek adják meg:

A tényezők közötti kölcsönhatás elemzése viszonylag összetett. Abban az esetben, ha a tényezők függetlenek, csak a tényezők fő hatásaira lehet kíváncsi. A képlet ekkor lesz:

Szemléltető példa

Tejtermelőnk vizsgálata méretének növelésével javítani kívánja elemzésének erejét. Ehhez egy másik gazdaság adatait tartalmazza. A számára közölt adatok a következők:

- A versenyre: 22,8; 21,7; 23,3; 23,1; 24,1; 22,3 és 22,7

- B versenyre: 23,1; 22,9; 21,9; 23,4 és 23,0

- C versenyre: 31,7; 33,1; 32,5; 35,1; 32,2 és 32,6

| Dof | Négyzetek összege | Variancia | F | P (X> F) | |

|---|---|---|---|---|---|

| verseny | 2 | 696,48 | 348,24 | 559,6811 | <2.2e-16 |

| központ | 1 | 8.46 | 8.46 | 13.6012 | 0,0009636 |

| verseny: központ | 2 | 12.23 | 6.11 | 9.8267 | 0,0005847 |

| Maradékok | 28. | 17.42 | 0,62 |

Többtényezős varianciaanalízis

Varianciabontás

Tovább bonthatjuk a varianciát úgy, hogy az egyes tényezőkhöz és egy-egy kifejezéshez hozzáadunk egy-egy kifejezést:

azzal a hatását a j edik faktor és a kölcsönhatás a j edik és a k th tényező.

A varianciaanalízis több variabilitási tényező esetén viszonylag összetett: helyes elméleti modellt kell meghatározni, tanulmányozni kell a tényezők közötti kölcsönhatásokat, elemezni a kovarianciát .

A varianciaanalízis alkalmazásának korlátai

Az eloszlások normalitása

A varianciabontás mindig érvényes, függetlenül a vizsgált változók megoszlásától. A Fisher-teszt végrehajtása során azonban feltételezzük ezen eloszlások normalitását. Ha az eloszlások kissé eltérnek a normalitástól, akkor a varianciaanalízis elég robusztus ahhoz, hogy felhasználható legyen. Abban az esetben, ha az eloszlások nagymértékben eltérnek a normálistól, elvégezhetünk egy változóváltozást (például úgy, hogy a változókat vesszük vagy ), vagy használhatunk egy nemparaméteres egyenértéket a varianciaanalízishez.

Homoscedasticity

Ezzel szemben az ANOVA egy másik nagyon erős és kevésbé nyilvánvaló feltételezést tesz. Valójában szükséges, hogy a különbözõ csoportokban a szórás azonos legyen. Ez a homoszkedaszticitási hipotézis . Az ANOVA nagyon érzékeny erre. Ezért használat előtt tesztelni kell.

Ellentétben azzal, amit ennek a módszernek a neve sugall, ez nem teszi lehetővé a magyarázandó változó varianciájának elemzését, hanem a magyarázható változók függvényében hasonlítja össze a magyarázandó változó eloszlásának átlagát.

Nem paraméteres megközelítések

Amikor az ANOVA előfeltevéseit nem tartják be ( például a homoszkedaszticitás ), gyakran halljuk, hogy ésszerűbb lehet használni az ANOVA nem parametrikus megfelelőjét: a Kruskal-Wallis tesztet az egy faktoros esetre, vagy kétfaktoros eset ismétlés nélkül, a Friedman-teszt. Ezek a tesztek nem ugyanúgy néznek ki. Mint fentebb említettük, az ANOVA lehetővé teszi egyváltozós mérés összehasonlítását két vagy több statisztikai populációból származó minták között. A Kruskal-Wallis-teszt nullhipotézisére a sztochasztikus homogenitás vonatkozik, vagyis minden statisztikai populáció sztochasztikusan (az egyszerűség kedvéért „véletlenszerűen” mondható el) egyenlő a többi populáció kombinációjával. Ezt a tesztet tehát az eloszlás érdekli, ellentétben az ANOVA-val, ezért nem tekinthető szoros értelemben vett egyenértékűnek.

Lásd is

- Statisztikai teszt

- A kovariancia ( ANCOVA ) elemzése kategorikus magyarázó változókkal rendelkező regressziós modellek esetében.

- Többváltozós elemzés ( MANOVA ) többváltozós modellek magyarázatához.

- Számos, a varianciaanalízist bemutató videó (egy faktor, két interakció nélküli tényező, általános eset) érhető el itt

Források

- G. Saporta, Valószínűség, adatelemzés és statisztika, p. 351-358 (1990)

- B. Scherrer, összehasonlítása az eszközök több független minta , vett Biostatisztika , Gaëtan Morin EDITEUR. o. 422–463 (1984)

- GD Ruxton, G. Beauchamp, Néhány javaslat a Kruskal-Wallis teszt megfelelő használatára , Animal Behavior 76 , 1083-1087 (2008) DOI : 10.1016 / j.anbehav.2008.04.011

- GA Ferguson és Y. Takane, a pszichológia és az oktatás statisztikai elemzése, McGraw-Hill Book (1989)

- GV Glass és JC Stanley, Statisztikai módszerek az oktatásban és a pszichológiában, Prentice Hall, USA, (1970)

Megjegyzések és hivatkozások

- Éric Yergeau és Martine Poirier, „ Varianciaanalízis ” , a http://spss.espaceweb.usherbrooke.ca/ ,2013(megtekintés : 2020. május 6. )

- (in) " A rokonok közötti összefüggés a mendeli öröklés feltételezésével "

- A kis mintából levezetett korrelációs együttható "valószínű hibájáról". Ronald A. Fisher. Metron, 1: 3-32 (1921)

- Lásd például a Toulouse III: „ univ-tlse1.fr ” ( Archívum • Wikiwix • Archive.is • Google • Mi a teendő? ) Tanfolyamot (konzultáció: 2013. november 5. ) 8. és 9. oldal. utaljon Scheffé klasszikus könyvére (1959)

- Lásd például: Lyon 1 Statistics Course és TD az interakcióelemzés példájára egy kétfaktoros modellben.

![{\ displaystyle i \ itt: [1, I]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e96f53df62c8af31a74553a067288881b60a818c)

![{\ displaystyle j \ itt: [1, n_ {i}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/14717818568c6dc60edf1cc5ce9c5974fed7d842)